AI leert zichzelf nieuwe trucjes aan

PLUS: onze gloednieuwe promptbibliotheek is live, waarom checklists je AI-assistent slimmer maken, en nepinfluencers op TikTok verkopen je straks spullen

De AI-wereld ontwikkelt zich razendsnel, en AI Report houdt je op de hoogte. Twee keer per week de nieuwste ontwikkelingen, tools en inzichten via onze nieuwsbrief en podcast.

De AI Report Prompt Library is live: 89 gouden tips om eindelijk wél goede antwoorden te krijgen

“ChatGPT, maak een presentatie!” *robotpraat volgt*

Herkenbaar? Het probleem zit niet in de AI, maar in hoe je ermee praat. Daarom hebben we al onze beste prompttechnieken verzameld in één overzichtelijke bibliotheek. Van basistips zoals ‘geef altijd context’ tot geavanceerde technieken voor complete AI-workflows.

Na honderden uren experimenteren ontdekten we de patronen die écht werken. Het resultaat: 89 beproefde toepassingen, verdeeld over vier levels. Begin met simpele brainstormtechnieken, bouw door naar strategische probleemoplossing, creëer je eigen AI-assistenten en leer hoe je AI ethisch inzet.

Professor Ethan Mollick zegt dat je minimaal tien uur nodig hebt om AI te beheersen. Met onze verzameling benut je die tien uur optimaal en bespaar je jezelf alle beginnersfrustraties.

Ontdek de AI Report Prompt Library →

🗞️ Het belangrijkste nieuws

MIT-onderzoekers bouwen AI die zichzelf slimmer maakt

Je kent het wel: je probeert jezelf een nieuwe vaardigheid aan te leren door YouTube-video’s te kijken en aantekeningen te maken. MIT-onderzoekers hebben nu AI ontwikkeld die precies hetzelfde doet, maar dan zonder YouTube. SEAL (Self-Adapting Language Models) leert zichzelf nieuwe dingen door zijn eigen studiemateriaal te maken én te bepalen hoe hij dat het beste kan gebruiken.

Wat is er aan de hand?

MIT heeft een raamwerk ontwikkeld waarmee grote taalmodellen zichzelf kunnen verbeteren zonder hulp van de mens. Met SEAL kan een AI zijn eigen trainingsdata genereren en vervolgens zijn eigen ‘hersenen’ (technisch gezien: de gewichten in het neurale netwerk) aanpassen. Het bijzondere? De AI leert dit door vallen en opstaan, net zoals een kind leert fietsen.

De resultaten zijn opmerkelijk. Bij kennistaken leerde de AI effectiever van zijn eigen aantekeningen dan van studiemateriaal dat werd gegenereerd door het veel grotere GPT-4-model. Bij puzzeloplossingstaken verbeterde het systeem van een hopeloze 0 procent naar een respectabele 72,5 procent nadat het had geleerd zichzelf te trainen.

Hoe werkt het?

Stel je voor dat je een student bent die niet alleen zijn eigen samenvattingen maakt, maar ook bepaalt welke leermethode het beste werkt. SEAL doet precies dat, maar dan in een digitale variant. Het systeem genereert wat de onderzoekers self-edits noemen – instructies voor het maken van synthetische data en het instellen van parameters om zijn eigen gewichten bij te werken.

Het leerproces verloopt via een versterkend leerproces (reinforcement learning). Simpel gezegd: de AI krijgt een beloning wanneer zijn zelfgemaakte aanpassingen tot betere prestaties leiden. Het is alsof je een hond een koekje geeft wanneer hij een kunstje goed uitvoert, maar dan complexer.

SEAL werkt met twee geneste lussen. De buitenste lus optimaliseert hoe de AI zijn eigen aanpassingen genereert. De binnenste lus past deze aanpassingen daadwerkelijk toe. Het is een vorm van metaleren: de AI leert hoe hij moet leren.

Een glimp van de toekomst

Deze ontwikkeling past naadloos in het scenario dat werd geschetst in het invloedrijke AI 2027-rapport. Daarin voorspellen experts dat we binnen twee jaar superintelligente AI krijgen, aangedreven door wat zij een intelligence explosion noemen. De kern van dat scenario is een zelfversterkend effect: zodra AI slim genoeg is om zelf AI-onderzoek te verbeteren, ontstaat er een versnelling. Verbeterde AI maakt nog betere AI mogelijk, wat weer leidt tot nóg betere AI, enzovoort.

Sam Altman, topman van OpenAI, deelde onlangs zijn visie op een toekomst met AI en robots die zichzelf verbeteren. Hij stelt zich voor dat de eerste miljoenen humanoïde robots traditioneel gefabriceerd worden, maar daarna “de hele toeleveringsketen kunnen beheren om meer robots te bouwen, die op hun beurt meer chipfabrieken en datacenters kunnen bouwen”. Een ambitieuze visie, al moeten we zijn uitspraken met een korreltje zout nemen – Altman staat niet bekend om zijn bescheidenheid.

Praktische toepassingen

De MIT-onderzoekers testten SEAL op twee gebieden. Bij kennisintegratie moest de AI informatie uit artikelen effectief in zijn ‘geheugen’ opnemen. Ze zagen de spectaculairste verbeteringen bij few-shot learning, waarbij de AI zich met heel weinig voorbeelden aan nieuwe taken aanpast. Waar standaardmethoden volledig faalden, behaalde SEAL het eerdergenoemde succespercentage van 72,5 procent.

Interessant detail: bij experimenten met het Qwen2.5-7B-model presteerde SEAL al na twee iteraties beter dan systemen die gebruikmaakten van data gegenereerd door het veel grotere GPT-4-model. Het is alsof een middelbare scholier effectiever leert van zijn eigen aantekeningen dan van een universitair leerboek.

De keerzijde

Natuurlijk is het niet allemaal rozengeur en maneschijn. De onderzoekers zijn eerlijk over de beperkingen. Het systeem heeft last van wat zij ‘catastrophic forgetting’ noemen – het systeem vergeet soms oude kennis wanneer het nieuwe dingen leert. Ook de rekenkracht die nodig is voor deze zelfverbeteringsprocessen is aanzienlijk. En de evaluatie blijft contextafhankelijk: wat in de ene situatie een verbetering is, kan in een andere situatie juist een achteruitgang betekenen.

Bovendien moeten we voorzichtig zijn met het trekken van conclusies, omdat SEAL nog in de onderzoeksfase zit. De weg van laboratorium naar praktische toepassing is vaak lang en hobbelig.

Waarom is dit belangrijk?

Voor professionals die met AI werken, schetst SEAL een toekomst waarin AI-systemen zich continu kunnen aanpassen aan nieuwe situaties zonder dat er telkens een team ontwikkelaars aan te pas moet komen. Denk aan een klantenservice-AI die zichzelf verbetert op basis van nieuwe productinformatie, of een medische AI die zich aanpast aan nieuwe onderzoeksresultaten.

Voor de bredere samenleving is de implicatie nog groter. We stevenen af op een wereld waarin AI niet alleen gereedschap is, maar een systeem dat zichzelf kan verbeteren. Dat roept fundamentele vragen op over controle, veiligheid en de rol van mensen in een wereld met zelfverbeterende machines.

Het onderzoek van MIT is geen sciencefiction meer, maar wetenschappelijke realiteit. Of we daar blij mee moeten zijn of juist bezorgd, is een vraag die we als samenleving snel zullen moeten beantwoorden. Want één ding is zeker: de ontwikkeling staat niet stil, of we er nu klaar voor zijn of niet.

TikToks virtuele verkopers: straks weet je niet meer of een influencer wel echt bestaat

Je scrolt tijdens je lunchpauze door TikTok en ziet iemand enthousiast een nieuwe gadget uitproberen. Alleen bestaat die persoon helemaal niet. TikTok biedt merken binnenkort de mogelijkheid om producten aan te prijzen via AI-influencers die bijna niet te onderscheiden zijn van mensen van vlees en bloed. De grens tussen echt en nep vervaagt steeds verder – en dat heeft nogal wat gevolgen voor de toekomst van online reclame.

Wat is er aan de hand?

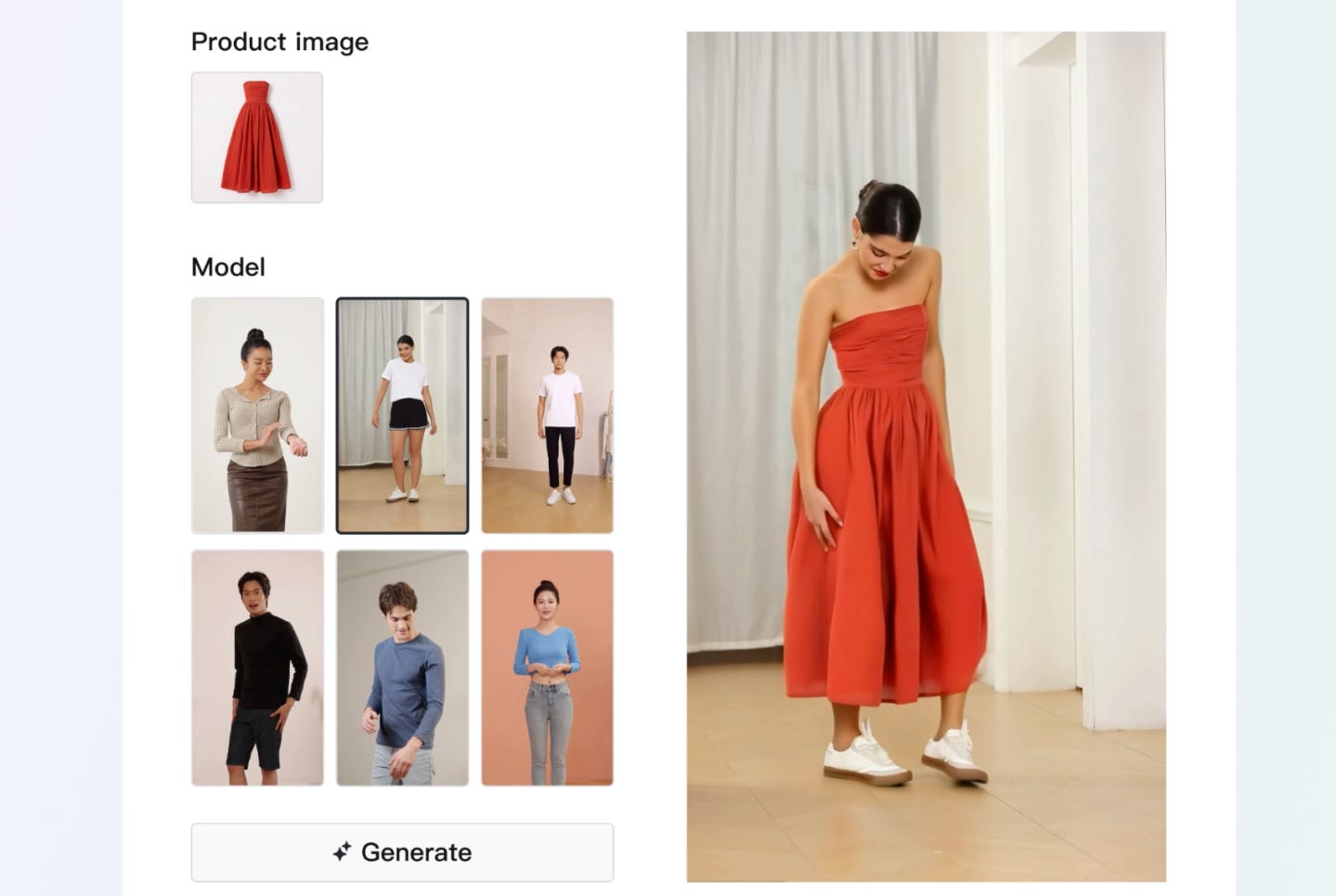

TikTok heeft nieuwe functies aangekondigd voor Symphony, het AI-advertentieplatform dat het bedrijf vorig jaar lanceerde. Waar het systeem eerst alleen basale video’s en afbeeldingen kon genereren, gaat het nu een stap verder. Adverteerders kunnen straks virtuele avatars laten creëren die producten vasthouden, kleding passen en apps demonstreren – precies zoals menselijke influencers dat doen.

Het proces is verbluffend simpel: upload een paar foto’s, typ een tekstje erbij, en voilà, je hebt een video waarin een virtuele influencer je product aanprijst. Functies die TikTok-gebruikers al kennen, zoals het maken van een video uit een foto, komen nu ook beschikbaar voor adverteerders.

Hoe werkt het precies?

De nieuwe AI-tools gaan verder dan het genereren van statische content. Ze bootsen het gedrag van echte influencers na: de virtuele avatars kunnen producten uitproberen, kleding showen en zelfs apps demonstreren op een telefoonscherm. Het is alsof je naar een gewone productreview kijkt, maar dan zonder dat er een echte persoon aan te pas komt.

Voor adverteerders is de aantrekkingskracht duidelijk. Een AI-avatar onderhandelt niet over tarieven, heeft geen contractvoorwaarden en kan eindeloos content produceren zonder pauze. Bovendien kunnen de tools content in verschillende talen genereren en specifieke doelgroepen targeten – allemaal geautomatiseerd.

De keerzijde voor menselijke influencers

Voor de duizenden influencers die hun brood verdienen met productplaatsingen dreigt er een dubbele klap. Niet alleen kunnen AI-avatars hun werk overnemen, de overvloed aan synthetische content kan ook de prijs drukken voor iedereen. Waarom zou een merk nog samenwerken met echte influencers als een virtuele variant goedkoper en makkelijker is?

Toch blijft menselijke creativiteit voorlopig nog waardevol. Veel contentmakers gebruiken AI-tools vooral achter de schermen – voor het bewerken van video’s, het plannen van content of het vinden van samenwerkingen.

Kanttekeningen bij de virtuele verkooppraat

Deze ontwikkeling roept natuurlijk de nodige vraagtekens op. Is het wel een echte productaanbeveling als degene die het aanprijst niet bestaat? En wat betekent het voor de geloofwaardigheid van online reviews als je niet meer kunt onderscheiden wie echt is en wie niet?

TikTok belooft dat alle AI-gegenereerde content een label krijgt, zodat kijkers weten waar ze naar kijken. Ook zou de content ‘meerdere veiligheidscontroles’ ondergaan. Maar of dat voldoende is om de transparantie te waarborgen, valt nog te bezien. De ervaring leert dat dergelijke labels makkelijk over het hoofd worden gezien – zeker als je snel door je feed scrolt.

Waarom is dit belangrijk?

Deze ontwikkeling raakt aan de kern van hoe we online informatie consumeren en producten ontdekken. Voor Nederlandse consumenten betekent het dat je straks extra alert moet zijn op wie of wat je probeert te overtuigen van een aankoop. Voor professionals in marketing en communicatie opent het nieuwe mogelijkheden, maar ook ethische dilemma’s.

De opmars van AI in de influencerindustrie lijkt onstuitbaar. Platforms zoals TikTok zetten vol in op deze technologie, waarschijnlijk omdat het hun eigen verdienmodel ten goede komt. Minder menselijke influencers betekent immers minder mensen die een deel van de advertentie-inkomsten opeisen.

Voor nu blijft de vraag: zijn we klaar voor een wereld waarin je favoriete productreviewer mogelijk een algoritme is? En belangrijker nog: hebben we daar wel zin in?

Robot voorspelt zijn eigen toekomst

Het Noorse robotbedrijf 1X onthulde deze week hun World Model: AI die robots laat ‘dromen’ over hun volgende acties. Hun humanoïde robot NEO kan nu visualiseren wat er gebeurt als hij een mok pakt, het aanrecht schoonmaakt of zelfs luchtgitaar speelt. De doorbraak? In plaats van elke beweging fysiek te testen, simuleert de AI duizenden scenario’s in een virtuele wereld. Resultaat: robots die sneller leren en veiliger werken in onze huizen. Sciencefiction wordt werkelijkheid: robots met verbeeldingskracht zijn werkelijkheid.

🔮 Prompt whisperer

Laat AI je checklist afvinken (en zie je resultaten verbeteren)

Je kent het wel: je stelt ChatGPT een vraag met meerdere onderdelen, en krijgt een antwoord waarbij de helft van je vragen onbeantwoord blijft. Of nog erger: de AI verzint er vrolijk op los en je moet zelf uitpluizen wat nou eigenlijk je oorspronkelijke vraag was. Gelukkig bestaat er een verrassend simpele techniek die dit probleem oplost: de checklistprompt. En nee, dit is geen saaie kantoortruc – het is een wetenschappelijk bewezen methode die je AI-resultaten meetbaar verbetert.

Waarom is dit belangrijk?

Stel je voor dat je een nieuwe medewerker instrueert om een complexe taak uit te voeren. Zonder duidelijke structuur raakt zo’n medewerker al snel het spoor bijster. Precies hetzelfde gebeurt met AI: zonder houvast dwaalt het af, vergeet onderdelen of verzint creatieve oplossingen voor problemen die je niet had.

De checklistprompt lost dit op door AI te dwingen systematisch te werk te gaan. Net zoals een piloot voor vertrek zijn checklist doorneemt, controleert de AI of alle onderdelen van je vraag zijn behandeld. Het resultaat? Completere antwoorden, minder hallucinaties en – misschien wel het belangrijkste – je kunt direct zien of alles is meegenomen.