Special: welkom in het tijdperk van massa-intelligentie

Vakantiecadeau: exclusief hoofdstuk uit Co-intelligentie

De AI-wereld ontwikkelt zich razendsnel, en AI Report houdt je op de hoogte. Twee keer per week de nieuwste ontwikkelingen, tools en inzichten via onze nieuwsbrief en podcast.

👋 Beste lezers,

Tijdens de feestdagen doen we het even anders. In plaats van onze reguliere nieuwsbrief brengen we de komende weken speciale edities uit waarin we nieuwe hoofdstukken delen uit de 2026-editie van Co-intelligentie – het boek van Ethan Mollick dat we samen met uitgeverij POM.Press uitbrengen.

Co-intelligentie werd vorig jaar een instant New York Times-bestseller en laat zien hoe je AI kunt inzetten als denkpartner in je werk en leven. Geen hype of doemdenken, maar praktische kennis van een Witte Huis-adviseur en hoogleraar die dagelijks onderzoekt hoe mens en machine het beste samenwerken. Omdat de AI-wereld niet stilstaat, hebben we voor deze nieuwe editie vijf hoofdstukken toegevoegd. Zie deze nieuwsbrieven als voorproefje én als cadeautje voor de feestdagen.

Vandaag deel twee: een hoofdstuk over het tijdperk van massa-intelligentie. Je leert waarom krachtige AI opeens voor iedereen beschikbaar is (hint: het is een stuk goedkoper geworden), waarom je geen ingewikkelde prompts meer nodig hebt, en wat er gebeurt als een miljard mensen tegelijk toegang krijgen tot tools die slimmer zijn dan ooit. Kortom: welkom in een wereld waarin AI net zo vanzelfsprekend wordt als Google.

Massa-intelligentie

Van GPT-5 tot ‘nano banana’: iedereen kan met krachtige AI aan de slag

28 augustus 2025

Meer dan een miljard mensen gebruiken regelmatig AI-chatbots. ChatGPT heeft ruim 700 miljoen wekelijkse gebruikers. Gemini en andere toonaangevende AI’s voegen daar nog eens honderden miljoenen aan toe. In mijn stukken concentreer ik me vaak op de vorderingen die AI maakt (zo wonnen de afgelopen paar weken chatbots van zowel OpenAI als Google AI gouden medailles tijdens de Internationale Wiskunde Olympiade), maar dat leidt af van een algemenere verschuiving die eraan zat te komen: we betreden het tijdperk van de massa-intelligentie waarin krachtige AI even toegankelijk is als zoeken met Google.

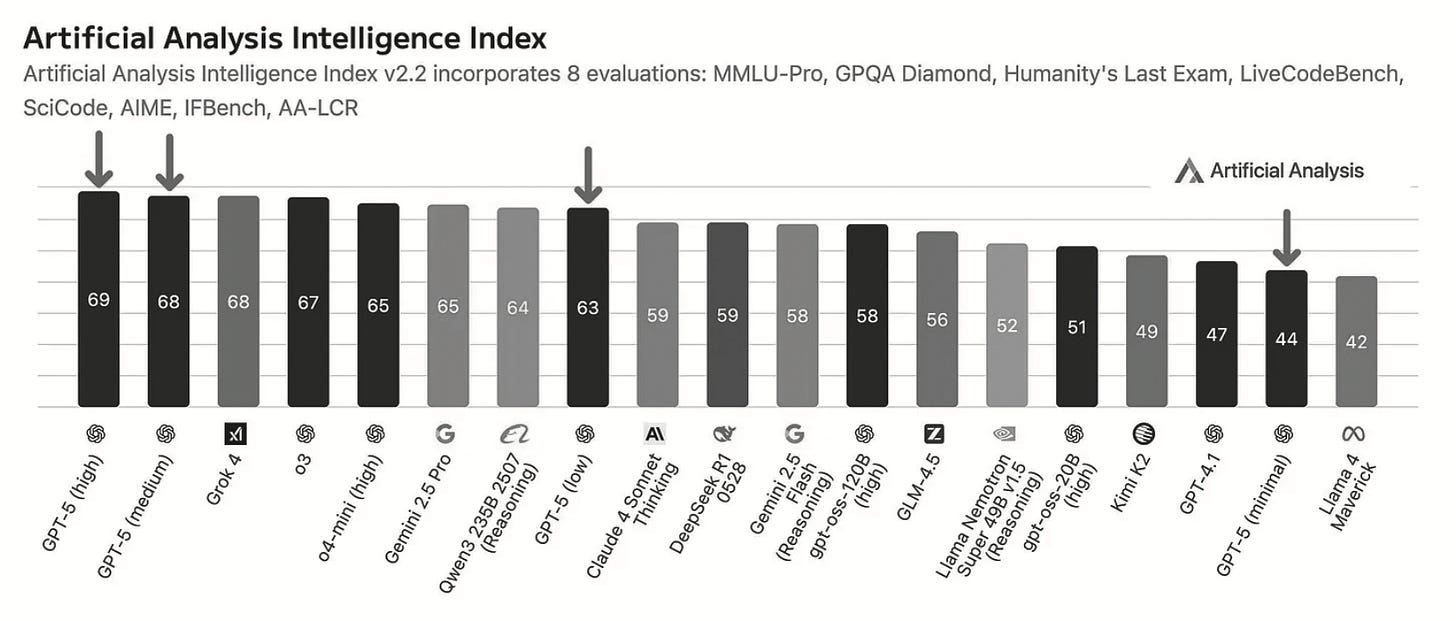

Tot voor kort kregen niet-betalende gebruikers van deze systemen (de overgrote meerderheid) alleen toegang tot oudere, kleinere AI-modellen die vaak fouten maakten en in beperkte mate bruikbaar waren voor complexe werkzaamheden. Voor de beste modellen, zoals reasoners die erg moeilijke problemen kunnen oplossen en veel minder hallucineren, moest je tussen de 20 en 200 dollar per maand neertellen. Maar zelfs dan moest je zelf uitzoeken welk model je koos en hoe je dat het best kon prompten. Maar de verdienmodellen en interfaces veranderen in hoog tempo, met behoorlijk grote consequenties voor hoe we allemaal werken, leren en denken.

Krachtige AI wordt goedkoper en toegankelijker

Voor de meeste gebruikers waren er twee obstakels om toegang tot krachtige AI te krijgen. De eerste was verwarring. Weinig mensen wisten hoe je een AI-model moest kiezen. Nog minder mensen wisten dat als je o3 uit een menu selecteerde, ChatGPT je toegang gaf tot een uitstekend redenerend AI-model, terwijl de keus voor 4o (wat een hoger nummer lijkt) veel minder capabele antwoorden opleverde. Volgens OpenAI koos nog geen 7 procent van de betalende klanten regelmatig voor o3, wat betekent dat zelfs grootverbruikers alle capaciteiten van reasoners misliepen.

Een andere factor was de kostprijs. Omdat de beste modellen duur zijn, kregen niet-betalende gebruikers er vaak geen toegang toe, of hooguit in zeer beperkte mate. Google zette de toon door een beetje gratis toegang te geven tot zijn beste modellen, maar OpenAI heeft verklaard dat, tot de lancering van GPT-5, niet-betalende klanten vrijwel geen toegang kregen tot redeneermodellen.

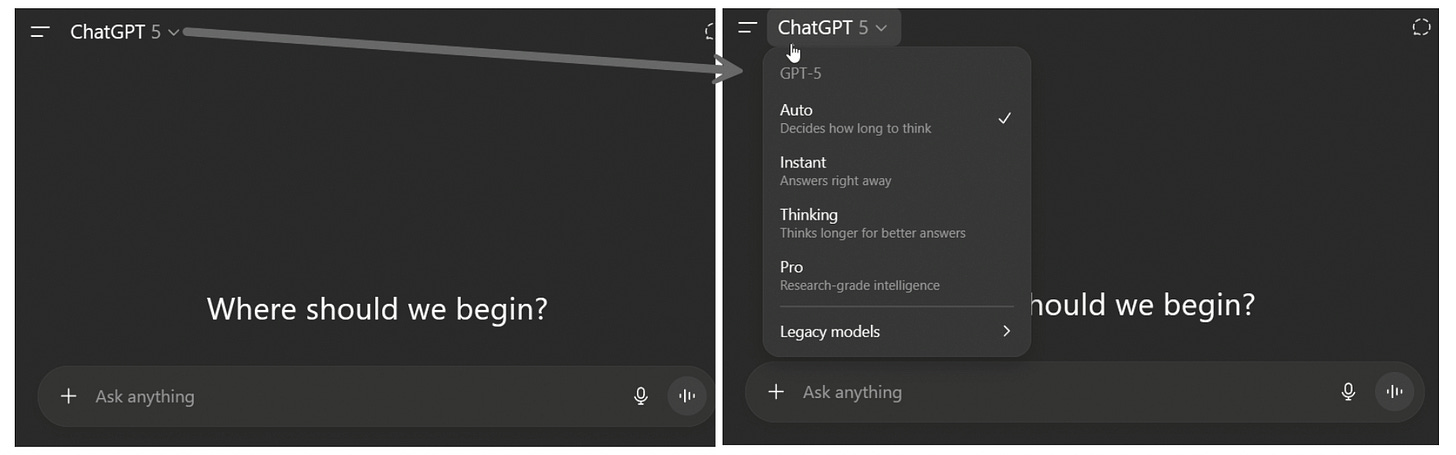

GPT-5 beloofde deze twee problemen op te lossen, wat deels verklaart waarom de lancering zo rommelig en verwarrend was. Eigenlijk is GPT-5 twee dingen. Ze is de overkoepelende naam voor een hele familie van behoorlijk uiteenlopende modellen, van de zwakkere GPT-5 Nano tot de krachtige GPT-5 Pro. De naam werd ook gegeven aan de tool die selecteert welk model gebruikt moet worden en hoeveel rekenvermogen de AI moet inzetten om je probleem op te lossen. Wanneer je aan ‘GPT-5’ schrijft, praat je in feite met een router die automatisch moet beslissen of je probleem door een kleiner, sneller model kan worden opgelost of dat het aan een krachtiger redeneermodel moet worden toegewezen.

Wanneer je ChatGPT 5 kiest, kies je in feite de automodus die een van de verschillende ChatGPT 5-modellen selecteert, waaronder een paar van de beste modellen ter wereld en andere die veel zwakker zijn. Als je een betalende gebruiker bent, selecteer dan ‘GPT-5 Thinking’ voor vrijwel elk probleem dat meer om het lijf heeft dan gewoon chatten.

Het was duidelijk hoe deze aanpak meer gebruikers toegang moest geven tot krachtige AI: als je gewoon wilde chatten, zette GPT-5 haar zwakkere gespecialiseerde chatmodellen in, maar als je een wiskundig probleem probeerde op te lossen, stuurde GPT-5 je naar haar tragere, duurdere model GPT-5 Thinking. Dat zou geld besparen en de beste AI’s toegankelijk maken voor meer mensen. Maar de lancering verliep niet vlekkeloos. De aanpak werd niet duidelijk uitgelegd en in het begin werkte de router niet goed. Daardoor kreeg de ene gebruiker van GPT-5 een heel slim antwoord en de andere een heel slecht antwoord. Ondanks deze problemen verklaarde OpenAI al snel dat het een succes was. Al een paar dagen na de lancering steeg het percentage betalende klanten die een redeneermodel gebruikten van 7 naar 24 procent en steeg het aantal niet-betalende klanten dat de krachtigste modellen gebruikte van bijna nul naar 7 procent.

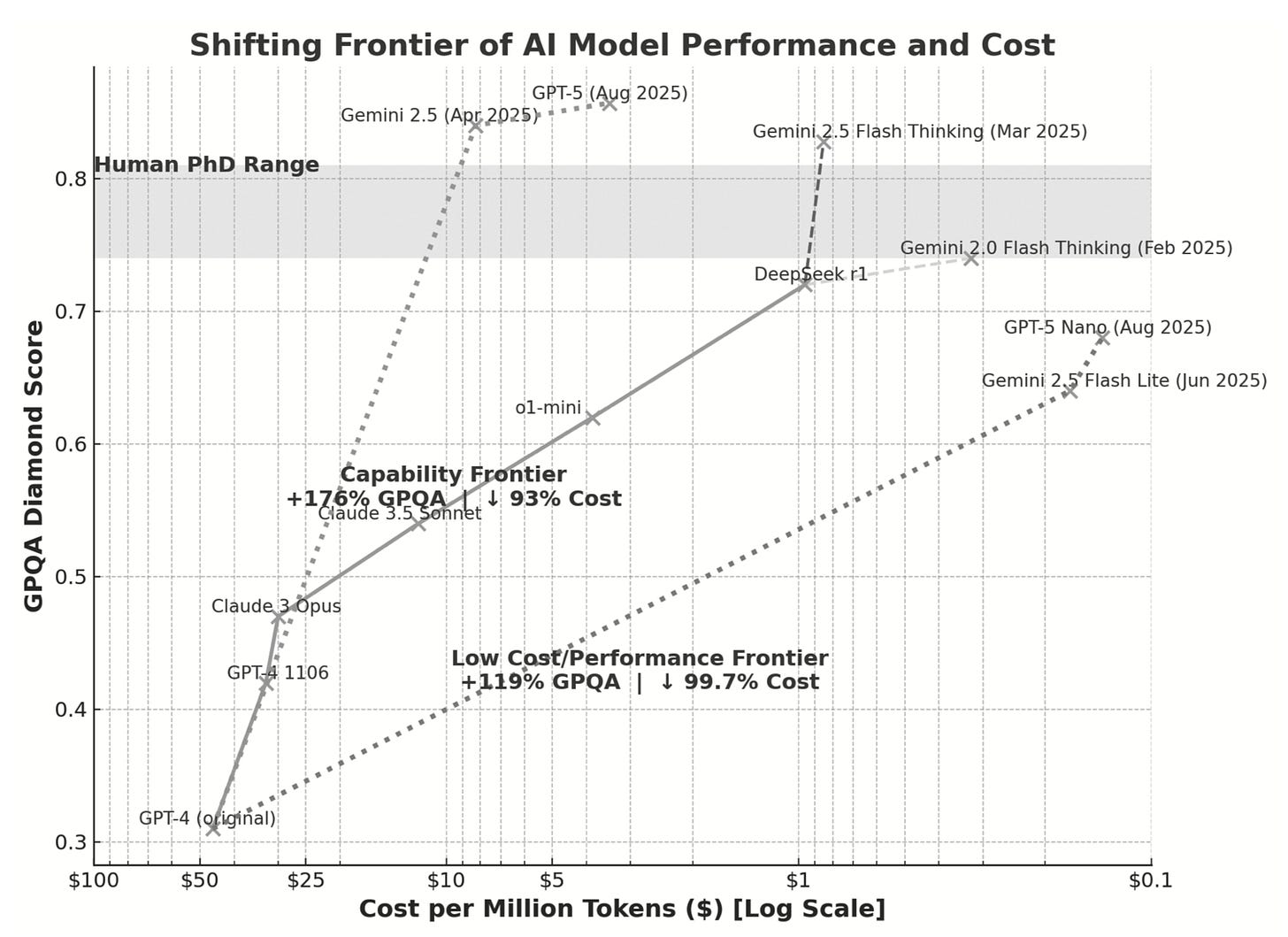

Die verandering is deels te danken aan het feit dat slimmere modellen ontzettend veel efficiënter draaien. De capaciteiten van AI zijn uitgezet op de y-as, en de logaritmisch dalende kosten op de x-as. Toen GPT-4 uitkwam, kostte het ongeveer 50 dollar om met een miljoen tokens te werken (een token is ruwweg één woord). Nu kost het ongeveer 14 dollarcent per miljoen tokens om GPT-5 nano te gebruiken, een veel capabeler model dan de oorspronkelijke GPT-4.

Deze verhoogde efficiency is niet alleen financieel gunstig, maar ook beter voor het milieu. Google heeft gemeld dat alleen al in het afgelopen jaar de energie-efficiency per prompt 33 keer zo groot is geworden. De marginale energie die wordt verbruikt bij een standaardprompt uit een modern LLM in 2025 is op dit moment betrekkelijk stabiel, zowel in onafhankelijke tests als in officiële rapporten. Het is ongeveer 0,0003 kWh, hetzelfde energieverbruik als 8 tot 10 seconden Netflix streamen of iets met Google zoeken in 2008 (het is interessant dat bij het maken van afbeeldingen ongeveer evenveel energie wordt verbruikt als bij een tekstuele prompt). Dat is de hoeveelheid energie die het kost om een standaardprompt te beantwoorden. Hierbij is geen rekening gehouden met de energie die nodig was om AI-modellen te trainen, een eenmalig proces waarbij heel veel energie wordt verbruikt. We weten niet hoeveel energie er wordt verbruikt bij het creëren van een modern model, maar er is geschat dat het trainen van GPT-4 iets meer dan 500.000 kWh heeft gevergd, evenveel als ongeveer 18 uur vliegen met een Boeing 737.

Hoeveel water deze modellen per prompt verbruiken is minder duidelijk, maar het loopt uiteen van een paar druppels tot een vijfde van een borrelglas (0,25 ml tot ruim 5 ml), afhankelijk van de definities van waterverbruik.

Door deze verbeteringen wordt AI krachtiger, en wordt het ook mogelijk om haar aan meer mensen te geven. De marginale kosten van elke extra gebruiker zijn sterk gedaald, wat meer bedrijfsmodellen, zoals advertenties, mogelijk maakt. Niet-betalende gebruikers kunnen nu prompts invoeren die hun twee jaar geleden geld hadden gekost. Zo krijgen een miljard mensen opeens toegang tot krachtige AI’s: niet door een of andere groots democratiseringsinitiatief, maar omdat de rendabiliteit het eindelijk mogelijk maakte.

Krachtige AI wordt makkelijk in het gebruik

Toegang krijgen tot een krachtige AI is niet genoeg. Mensen moeten haar ook gaan gebruiken. AI goed benutten was vroeger een hele toer: je moest een prompt construeren met technieken zoals chain-of-thought, en tips en trucs leren om zo veel mogelijk uit je AI te halen. In een recente reeks experimenten hebben we echter ontdekt dat die technieken niet echt meer helpen. Krachtige AI-modellen zijn beter geworden in doen wat je vraagt, en zelfs in het achterhalen wat je wilt en meer doen dan wat je verzocht hebt (en nee, ze bedreigen of aardig tegen ze doen helpt meestal niet).

Niet alleen tekstmodellen worden goedkoper en makkelijker in het gebruik. Google heeft een nieuwe afbeeldingsgenerator uitgebracht met de codenaam ‘nano banana’ en de veel suffere officiële naam Gemini 2.5 Flash Image Generator. Het model werkt niet alleen uitstekend (hoewel het beter is in bestaande afbeeldingen editen dan nieuwe maken), maar is ook zo goedkoop dat niet-betalende gebruikers het mogen gebruiken. En anders dan eerdere generaties AI-afbeeldinggenerators is het heel goed in het opvolgen van instructies in gewone taal.

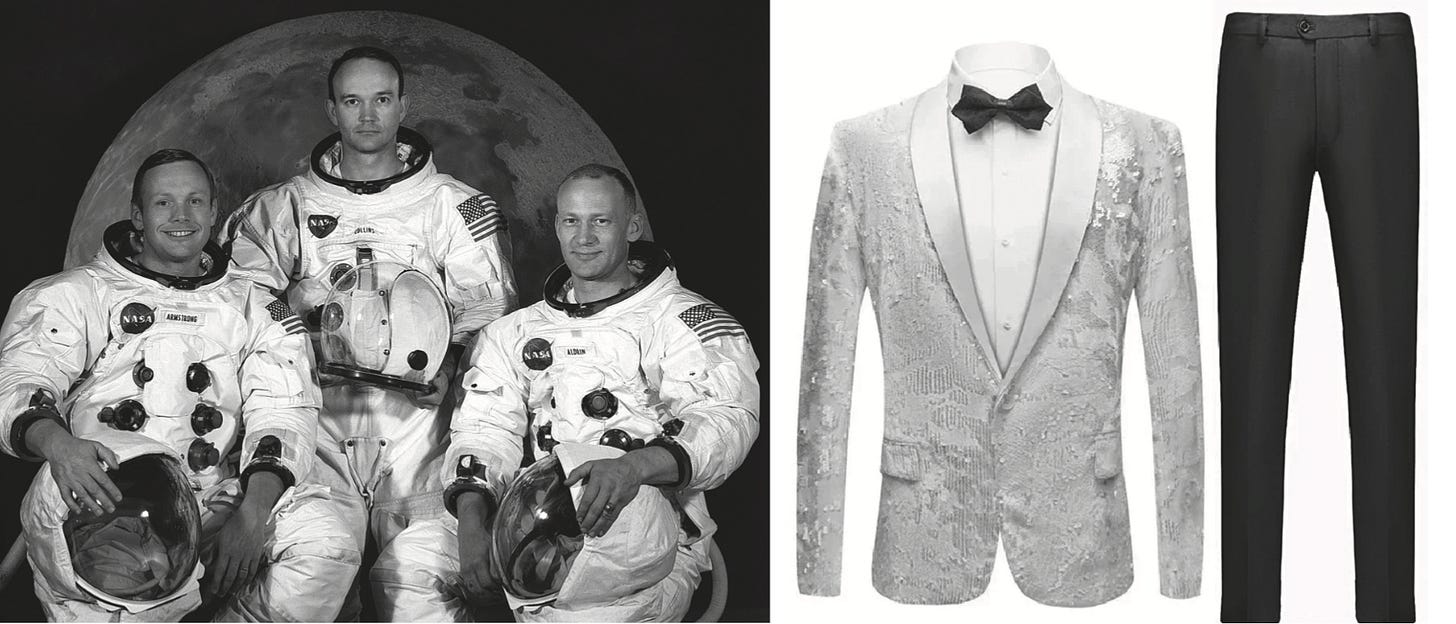

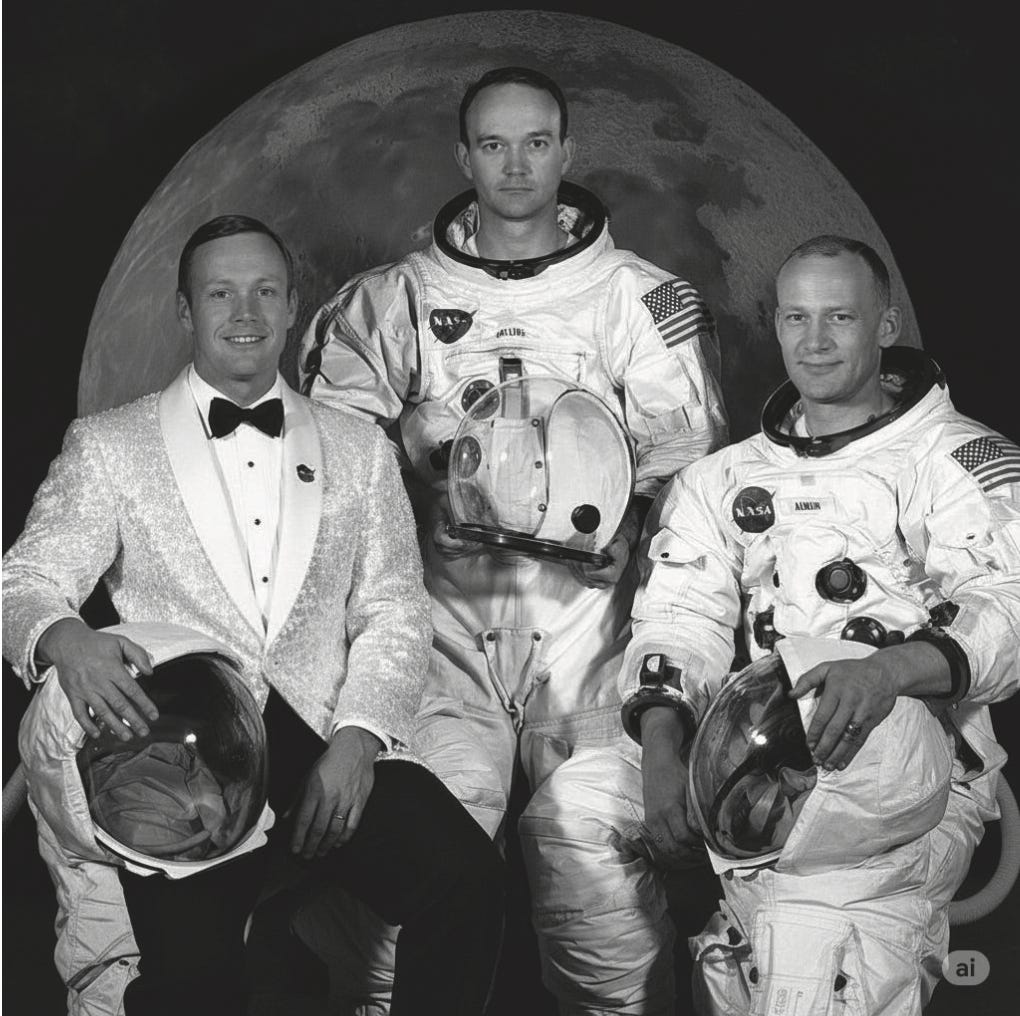

Om een voorbeeld te geven van zowel de kracht als het gebruiksgemak, uploadde ik een iconische (en rechtenvrije) foto van de astronauten van de Apollo 11 en een willekeurig plaatje van een glinsterende smoking en gaf het afbeeldingenmodel de doodsimpele prompt: trek Neil Armstrong op links deze smoking aan.

Hier kwam ze een paar seconden later mee:

Er zijn een paar afwijkingen die een expert wel zou opmerken, maar toch is het indrukwekkend hoe realistisch de vouwen in de smoking zijn en hoe die in het tafereel past (het NASA-speldje op de revers was een mooi detail). Het proces is nog altijd vrij willekeurig, waardoor beeldredactie met AI niet geschikt is voor veel professionele toepassingen, maar voor de meeste mensen zal dit een reusachtige sprong vooruit zijn, niet alleen in wat ze kunnen doen, maar ook in hoe makkelijk het is.

We kunnen een stapje verder gaan: toon me nu een foto waarop Neil Armstrong en Buzz Aldrin, in dezelfde outfits, op hun stoel zitten in een modern vliegtuig, Neil oogt ontspannen, en leunt achterover terwijl hij trompet speelt, Buzz lijkt nerveus en houdt een hamburger vast, op de middelste stoel zit een realistische otter op een stoel die een laptop gebruikt.

Hier gebeurt veel tegelijk: een behoorlijk indrukwekkende output van de AI (let op de gezichtsuitdrukkingen en hoe ze de ring van Buzz en het speldje op Neils revers heeft behouden). Een beroemd historisch moment, vervormd en mogelijk gemaakt door AI. En daarmee een potentiële waarschuwing voor alle bizarre dingen die ons te wachten staan wanneer dit soort technologie gemeengoed wordt.

De bizarre kanten van massa-intelligentie

Wanneer krachtige AI in de handen van een miljard mensen valt, zullen er een heleboel dingen tegelijk gebeuren. En er gebeuren nu al een heleboel dingen tegelijk.

Sommige mensen ontwikkelen een intense relatie met een AI-model terwijl anderen van de eenzaamheid worden gered. Bij sommigen kunnen AI-modellen mentale problemen en gevaarlijk gedrag veroorzaken, terwijl ze bij anderen worden gebruikt om ziekten te diagnosticeren. Ze worden gebruikt om necrologieën en religieuze teksten te schrijven, om niet zelf je huiswerk te hoeven maken, om nieuwe bedrijven te lanceren en voor duizenden andere onverwachte toepassingen. Deze toepassingen, zowel de bezwaren als de voordelen, zullen waarschijnlijk alleen maar in aantal toenemen als AI-systemen krachtiger worden.

En hoewel de afbeeldingengenerator van Google guardrails heeft om misbruik te beperken, en ook onzichtbare watermerken waarmee AI-beelden herkend kunnen worden, verwacht ik dat AI-beeldgenerators die veel minder restrictief zijn de komende maanden de kwaliteit van nano banana dicht zullen naderen.

De AI-bedrijven (of je hun beloftes over veiligheid nu wel of niet gelooft) lijken net zo slecht als wij allemaal in staat te zijn om dit allemaal te bevatten. Wanneer een miljard mensen over geavanceerde AI beschikken, is het tijdperk van de massa-intelligentie aangebroken. Alle instituties die we hebben – scholen, ziekenhuizen, gerechtshoven, bedrijven en overheden – waren geconstrueerd voor een wereld waarin intelligentie schaars en duur was. Nu moet elke beroepsgroep, elk instituut en elke gemeenschap bedenken hoe ze náást massa-intelligentie kan bestaan. Hoe beteugelen we een miljard mensen die AI gebruiken en hoe beheersen we de chaos die daarmee gepaard gaat? Hoe bouwen we het vertrouwen weer op wanneer iedereen alles kan fabriceren? Hoe behouden we wat er waardevol is aan menselijke deskundigheid terwijl we de toegang tot kennis democratiseren?

Dus zo staan we ervoor. Krachtige AI is nu zo goedkoop dat die kan worden weggegeven, zo makkelijk dat je geen handleiding nodig hebt, en zo capabel dat ze allerlei intellectuele werkzaamheden beter kan verrichten dan mensen. Over de hele wereld staan ontelbare kansen en problemen op het punt te verschijnen in klaslokalen, collegezalen, gerechtshoven en directiekamers. Het tijdperk van de massa-intelligentie is wat er gebeurt als je een miljard mensen toegang geeft tot een ongekende verzameling tools en kijkt wat ze daarmee doen. We staan op het punt om te ontdekken hoe dat is.

Wil je meer lezen?

En check hier de Substack van Ethan Mollick.