Hoe een Substack-essay de beurs deed kelderen

PLUS: Anthropic moet kiezen tussen principes en het Pentagon, en plan meetings door een AI te cc'en

De AI-wereld ontwikkelt zich razendsnel, en AI Report houdt je op de hoogte. Twee keer per week de nieuwste ontwikkelingen, tools en inzichten via onze nieuwsbrief en podcast.

🗞️ Het belangrijkste nieuws

Hoe een Substack-essay paniek veroorzaakte op Wall Street

Je leest dit op Substack. Hetzelfde platform waar afgelopen zondag een essay verscheen dat deze week miljarden van de beurs veegde. We leven in rare tijden.

Wat is er gebeurd?

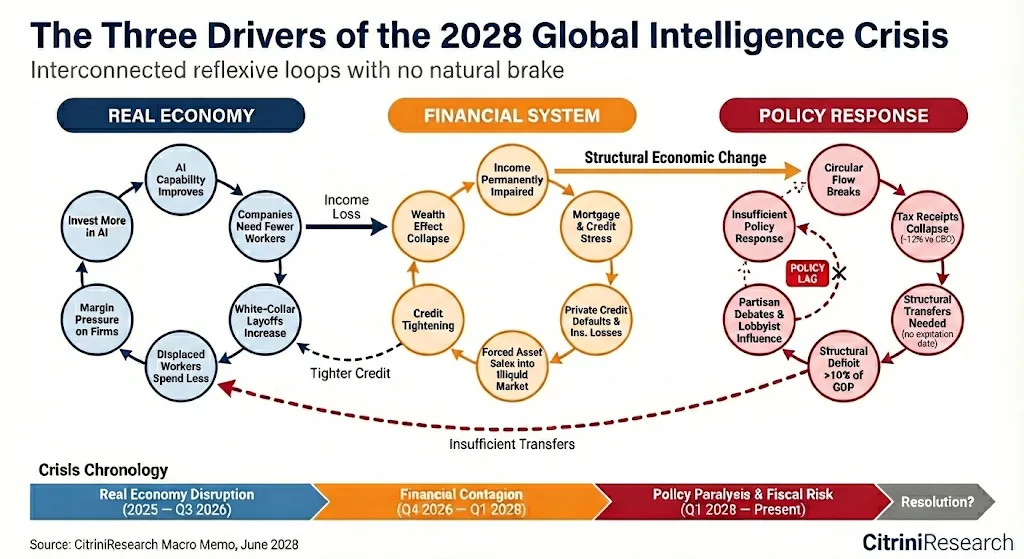

James van Geelen, oprichter van onderzoeksbureau Citrini Research, publiceerde zondag een gedachte-experiment van 7000 woorden met de titel The 2028 Global Intelligence Crisis. Het schetst een scenario waarin AI zo snel verbetert dat bedrijven massaal kantoorpersoneel ontslaan, waardoor consumenten minder uitgeven en bedrijven nóg meer op AI overstappen. Een neerwaartse spiraal die in dit doemscenario leidt tot 10 procent werkloosheid en een beurscrash van 38 procent.

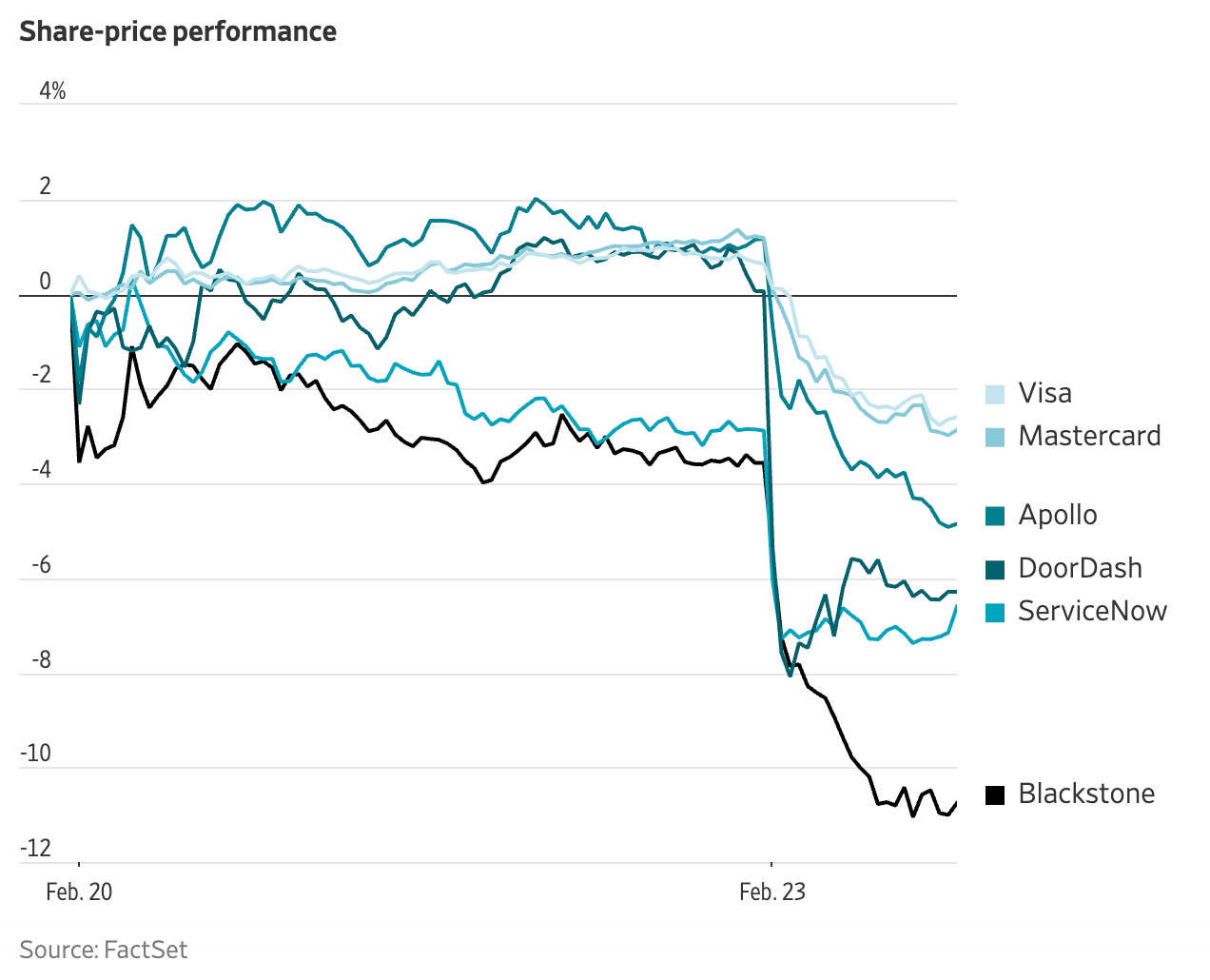

Maandagochtend was het essay het gesprek van de dag op Wall Street. En toen de beurs openging, begon de uitverkoop. IBM daalde 13 procent – de grootste eendaagse val sinds 2000. DoorDash, American Express, Mastercard, Visa, Uber kregen allemaal flinke klappen. De S&P 500 sloot ruim een procent lager.

Van Geelen zelf was verbijsterd. “Als ik had verwacht dat dit invloed zou hebben op aandelenkoersen, had ik het niet gratis gepubliceerd,” vertelde hij aan Bloomberg.

Ghost GDP: the ghost in the machine

De kern van Van Geelens betoog draait om wat hij ghost GDP noemt: economische output die wel in de cijfers verschijnt, maar nooit bij gewone mensen terechtkomt. AI maakt bedrijven productiever, de economie groeit op papier, maar machines geven geen geld uit aan boodschappen of vakanties. Als die productiviteitswinst vooral naar aandeelhouders gaat terwijl werknemers hun baan verliezen, krijg je groei zonder welvaart.

Het essay voorspelt dat AI eerst de ‘frictie’ uit de economie haalt – al die tussenpersonen die we betalen omdat complexiteit ons te veel moeite kost. Reisplatforms, belastingadviseurs, financieel planners: het zijn allemaal beroepen die bestaan omdat ze complexe taken oplossen die jij liever vermijdt. Voor AI is niets vervelend.

Waarom dit essay, waarom nu?

De timing was cruciaal. Beleggers waren al wekenlang nerveus door de stroom aan AI-aankondigingen die steeds meer sectoren leek te bedreigen: eerst software, toen juridische dienstverlening, daarna cyber security. Het Citrini-essay gaf woorden aan een angst die al sluimerde.

Maar er speelt iets groters. Vroeger kwam zo’n invloedrijke analyse van Goldman Sachs of Morgan Stanley. Nu komt die van een 33-jarige voormalig ambulanceverpleger die zijn gedachten deelt op Substack. Zoals Brandon Gorrell van techpodcast TBPN opmerkte: de narratieve macht verschuift van traditionele instituten naar makers op gedecentraliseerde platforms.

Even dimmen

Het essay is nadrukkelijk een gedachte-experiment, geen voorspelling. Van Geelen zelf zegt dat hij de these intern probeerde te ontkrachten, maar niet op nul procent kans uitkwam. Critici wijzen erop dat eerdere technologische revoluties – van de stoommachine tot de computer – uiteindelijk meer banen creëerden dan ze vernietigden.

Een tikkeltje ironisch: Deutsche Bank liet recent een AI-model voorspellen hoeveel banen AI zou kosten: 92 miljoen tegen 2030, tegenover 170 miljoen nieuwe rollen die erbij komen.

Econoom Alex Imas van de University of Chicago werkte het doemscenario wiskundig uit en concludeert: de voorwaarden voor daadwerkelijke economische krimp zijn “waarschijnlijk te extreem om in de praktijk te gelden”. Volledige automatisering, geen beleidsreactie, én institutioneel falen – alle drie tegelijk is onwaarschijnlijk. AI kan de groei wel degelijk drukken, maar negatieve groei vereist een perfecte storm.

De aandelen herstelden dinsdag alweer. Maar de paniek van één dag liet zien hoe gespannen de situatie is. En hoe een goed getimed essay op Substack tegenwoordig meer kan bewegen dan een rapport van een zakenbank.

Van Geelen hoopt dat het essay een gesprek op gang brengt. “Wat gebeurt er na het hoogtepunt van optimisme over AI-disruptie? Als samenleving worden we geconfronteerd met het feit dat het meest productieve bezit altijd banen voor mensen creëerde. Tot nu toe.”

Pentagon geeft Anthropic ultimatum: buig of breek

De vete tussen Anthropic en het Amerikaanse ministerie van Defensie krijgt een staartje. Vorige week schreven we over de groeiende spanningen tussen de maker van Claude en het Pentagon. Nu heeft minister van Defensie Pete Hegseth een ultimatum gesteld: vrijdag om 17.01 uur moet Anthropic akkoord zijn met de eisen van het leger, of er volgen zware sancties.

Wat is er aan de hand?

Hegseth ontbood Anthropic-CEO Dario Amodei dinsdag naar Washington voor een gesprek dat “niet warm en gezellig” was, aldus een Pentagon-functionaris. De boodschap was helder: verwijder de beperkingen op militair gebruik van Claude, of we nemen maatregelen.

Anthropic weigert twee dingen: het gebruik van Claude voor massasurveillance van Amerikaanse burgers, en het inzetten van de AI in volledig autonome wapensystemen – wapens die zonder menselijke tussenkomst kunnen doden. Het Pentagon vindt dat onacceptabel. Het leger wil dat AI-bedrijven hun modellen beschikbaar stellen voor “alle wettige doeleinden”, zonder uitzonderingen.

Als Anthropic niet buigt, dreigt Hegseth met twee straffen. De eerste: het contract van 200 miljoen dollar opzeggen en Anthropic bestempelen als ‘risico voor de toeleveringsketen’. Dat klinkt bureaucratisch, maar de gevolgen zijn verstrekkend: alle bedrijven die zaken doen met het Pentagon zouden dan moeten bewijzen dat ze geen Claude gebruiken. Normaal gesproken is dit een straf voor buitenlandse vijanden, niet voor Amerikaanse techbedrijven.

De tweede optie: de Defense Production Act inroepen, een oorlogswet waarmee de overheid bedrijven kan dwingen te produceren wat het leger nodig heeft. Die wet werd gebruikt tijdens de coronapandemie voor vaccins en beademingsapparatuur, maar nooit eerder tegen een softwarebedrijf.

Waarom dit belangrijk is

Claude is momenteel het enige AI-model dat draait op de besloten systemen van het Amerikaanse leger. Het werd onder meer ingezet bij de militaire operatie om de Venezolaanse oud-president Maduro op te pakken vorige maand. Die afhankelijkheid maakt de situatie extra pijnlijk. “De enige reden dat we nog met deze mensen praten, is dat we ze nodig hebben. Nu. Het probleem voor hen is dat ze zó goed zijn,” aldus een defensiefunctionaris.

Ondertussen tekenden concurrenten OpenAI, Google en Elon Musks xAI wél contracten waarin ze het leger toestaan hun AI te gebruiken voor alle wettige doeleinden. xAI’s Grok mag sinds deze week ook op de besloten netwerken draaien.

Anthropic houdt voet bij stuk

Na het gesprek liet Anthropic weten dat het “constructieve gesprekken” blijft voeren, maar volgens bronnen is het bedrijf niet van plan zijn rode lijnen te laten varen. Amodei ontkende dat Anthropic ooit bezwaar heeft gemaakt tegen legitieme militaire operaties of zich ermee heeft bemoeid.

Het conflict raakt aan een fundamentele vraag: wie bepaalt de grenzen van militair AI-gebruik? Het Pentagon vindt dat alleen de wet die grenzen mag stellen, niet een privébedrijf. Anthropic vindt dat sommige toepassingen – autonome dodelijke wapens, massasurveillance – nu nog niet verantwoord zijn, ongeacht wat de wet toestaat.

Een ongemakkelijke kanttekening

De timing is pikant. Deze week publiceerde onderzoeker Kenneth Payne van King’s College London een studie waarin hij GPT-5.2, Claude en Gemini tegen elkaar liet spelen in gesimuleerde oorlogssituaties. De uitkomst: in 95 procent van de scenario’s kozen de AI-modellen ervoor om kernwapens in te zetten. De modellen bleken minder terughoudend dan mensen als het aankomt op nucleaire escalatie.

Het onderstreept waarom Anthropic huiverig is voor autonome wapensystemen. Maar het maakt de spagaat ook zichtbaar: hoe lang kun je principieel blijven als je grootste klant dreigt je kapot te maken?

Anthropic beschuldigt Chinese labs van grootschalige datadiefstal

Het is niet de eerste keer dat dit gebeurt. Begin vorig jaar beschuldigde OpenAI DeepSeek ervan hun technologie te hebben ‘gestolen’ via een techniek genaamd distillatie. Nu komt Anthropic met een soortgelijke aanklacht – maar dan met namen, cijfers en bewijsmateriaal.

Wat is er gebeurd?

Anthropic claimt dat drie Chinese AI-labs – DeepSeek, Moonshot en MiniMax – via zo’n 24.000 nepaccounts meer dan 16 miljoen gesprekken met Claude hebben gevoerd om hun eigen modellen te trainen. De labs gebruikten proxynetwerken om toegang te krijgen tot Claude, dat officieel niet beschikbaar is in China.

De operaties waren specifiek gericht op Claudes sterkste punten: redeneren, programmeren en het gebruik van tools. In één geval draaide MiniMax binnen 24 uur zijn hele operatie om toen Anthropic een nieuw model uitbracht – het wilde de nieuwste mogelijkheden meteen aftappen. Anthropic zegt dat het de aanvallen kon traceren naar specifieke onderzoekers bij de labs via metadata en IP-adressen.

Even opfrissen: wat is distillatie?

Bij distillatie train je een kleiner model op de output van een groter model. Je stelt het grote model miljoenen vragen en gebruikt die antwoorden om je eigen model te verbeteren. Het is alsof je een leerling traint door hem een leraar te laten nadoen – zonder zelf de leraar te hoeven betalen.

De kritiek op deze beschuldigingen is dan ook ironisch. AI-labs doen allemaal aan distillatie. Sterker nog: grote taalmodellen zijn in essentie een distillatie van het hele internet – alle teksten en menselijke kennis samengeperst in één model. OpenAI, Anthropic en Google liggen zelf onder vuur vanwege het trainen op auteursrechtelijk beschermd materiaal. Anthropic betaalde vorig jaar nog een schikking van 1,5 miljard dollar aan uitgevers.

Toch zit er een kern in

Maar er is een reëel punt. Pioniers zoals Anthropic en OpenAI hebben miljarden geïnvesteerd in het uitvinden van nieuwe technieken. Als concurrenten die vermogens voor een fractie van de kosten kunnen kopiëren, wie betaalt er dan voor de volgende doorbraak?

Anthropic koppelt de beschuldiging ook aan nationale veiligheid: gedistilleerde modellen missen de veiligheidsgrenzen die Amerikaanse labs inbouwen. Als die capaciteiten in Chinese militaire systemen belanden, is dat problematisch.

Of dit juridisch standhoudt, is een andere vraag. Maar de boodschap is helder: Anthropic wil het narratief bijstellen dat Chinese opensourcemodellen uit het niets de frontier labs inhalen. Een Anthropic-onderzoeker stelde: “Voorsprong verkrijgen gebeurt door innovatie, niet door distillatie.”

Hoe GenAI bijdraagt aan een efficiëntere energiesector

Een efficiëntere en veerkrachtige energiesector is mogelijk met gebruik van GenAI. Mits strategisch ingezet, geïntegreerd in de operatie en ondersteund door solide governance, zo laat PwC-onderzoek zien.

🛠️ AI Toolkit+

Plan meetings door gewoon een e-mailadres in de cc te zetten

Je wilt een meeting plannen met een klant of collega, en wat volgt is een eindeloze e-mailwisseling. “Dinsdag 14:00?” “Nee, dan kan ik niet.” “Woensdag?” “Alleen ’s ochtends.” Tegen de tijd dat je een moment hebt gevonden, ben je drie dagen verder. De tool die we vandaag bespreken lost dat op door gewoon mee te lezen in je e-mailthread en het plannen over te nemen.

Geen Calendly-links meer sturen die kil aanvoelen, geen eindeloze threads over “past dinsdag of woensdag beter?” – je zet gewoon een AI in de cc en die regelt de rest.

Wat krijg je vandaag?

Een AI-assistent die meetings plant vanuit je e-mailthread – geen extra apps of dashboards.

Hoe je met één simpele cc een einde maakt aan heen-en-weer-mailen.

Een tool die je agenda kent, tijdzones begrijpt en automatisch uitnodigingen verstuurt.

Werkt ook via WhatsApp als je onderweg bent.

Gratis te gebruiken, gebouwd door een team met ervaring bij Netflix, Disney en Google.

Tips om de tool optimaal in te stellen voor jouw werkweek.