Moet je AI wel in de kinderkamer toelaten?

PLUS: OpenAI’s infrastructuurproblemen, Chinese AI die zonder mensen leert denken, en hoe je een veilige AI-tutor bouwt voor je kind

De AI-wereld ontwikkelt zich razendsnel, en AI Report houdt je op de hoogte. Twee keer per week de nieuwste ontwikkelingen, tools en inzichten via onze nieuwsbrief en podcast.

💡 Vandaag: ons derde AI Report-webinar!

Over een halfuur gaan we live met Alexander en Wietse! Ze beantwoorden een uur lang al je AI-vragen en delen hun dagelijkse ervaringen, rechtstreeks vanuit de Amsterdamse studio.

Als betalend abonnee krijg je automatisch toegang – onderaan deze mail vind je de link naar de meeting. Nog geen lid? Voor een tientje per maand ben je verzekerd van je plek bij alle webinars én ontvang je twee keer per week onze volledige nieuwsbrief.

Tot zo!

🗞️ Het belangrijkste nieuws

OpenAI’s megaproject Stargate loopt vast op Trumps handelspolitiek

Het leek zo mooi: OpenAI zou samen met SoftBank voor 500 miljard dollar aan AI-infrastructuur bouwen in de VS. Nu blijkt dat de financiering hapert en de internationale uitbreiding al wordt aangekondigd voordat er één datacenter af is. Welkom in de wereld van Silicon Valley-beloftes en de weerbarstige werkelijkheid die daarachter schuilgaat.

Wat is er aan de hand?

In januari kondigden OpenAI-CEO Sam Altman en SoftBank-topman Masayoshi Son aan dat ze per direct 100 miljard dollar zouden investeren in Amerikaanse AI-infrastructuur, met als einddoel een totaalbedrag van 500 miljard. Drie maanden later is er nog geen financieringsplan en zijn er geen concrete deals gesloten met banken of investeerders.

De Trump-factor

President Trumps agressieve importheffingen gooien roet in het eten. Banken als JPMorgan en Mizuho, en investeringsmaatschappijen als Apollo Global en Brookfield aarzelen om in te stappen. Nieuwe heffingen op serverracks, koelsystemen en chips kunnen de bouwkosten met 5 tot 15 procent opdrijven. Tel daarbij op dat financiers huiverig zijn voor risicovolle investeringen door de dreiging van een mondiale recessie.

Concurrentie uit China

De opkomst van goedkopere AI-modellen, zoals die van de Chinese startup DeepSeek, maakt investeerders extra nerveus. Ze vragen zich af wat dit betekent voor de winstgevendheid van OpenAI’s diensten op de lange termijn. Ondertussen schroeven grote techbedrijven als Microsoft en Amazon hun datacenterplannen juist terug.

Internationale ambities

Opvallend genoeg kondigde OpenAI deze week aan het Stargate-project uit te breiden naar Europa. Vice-president Chris Lehane spreekt over nieuwe projecten in Frankrijk, het VK en Duitsland om ‘democratische AI’ te promoten - een niet zo subtiele verwijzing naar de concurrentie met China.

Kanttekeningen

De timing van de aankondiging roept vragen op. Analisten van TD Cowen waarschuwen dat de bouwkosten van datacenters met 5 tot 15 procent kunnen stijgen door nieuwe handelstarieven. Grote techbedrijven als Microsoft en Amazon schroeven hun datacenterplannen juist terug.

“Het zou fijn zijn als we precies wisten waar al dat geld de komende kwartalen heen gaat,” zegt Richard Kaye, co-hoofd Japan-strategie bij Comgest Asset Management. “Maar dat weet waarschijnlijk zelfs meneer Son zelf nog niet.” Son is de oprichter van SoftBank en bekend om zijn optimistische langetermijnvisie.

Waarom is dit belangrijk?

De vertraging bij Stargate raakt direct aan de beschikbaarheid en betaalbaarheid van AI-diensten. OpenAI kan nu al de vraag amper bijbenen - toen hun razendpopulaire GPT-4o plaatjesgenerator uitkwam, meldde Altman al dat hun “GPU’s smolten”. Krachtige modellen zoals GPT-4.5 zijn bewust gelimiteerd in gebruik vanwege de enorme rekenkracht die ze vergen.

Meer datacenters betekent lagere kosten voor eindgebruikers en betere toegang tot AI-diensten. Maar de weg daarnaartoe blijkt lastiger dan gedacht: geopolitieke spanningen, handelstarieven en economische onzekerheid gooien zand in de machine.

Ondertussen bij OpenAI

Te midden van deze uitdagingen kondigt OpenAI wel een nieuwe topbenoeming aan: Fidji Simo wordt CEO van de divisie Applications. Simo, die overkomt van Instacart, moet de commerciële activiteiten stroomlijnen terwijl CEO Sam Altman zich meer op onderzoek en veiligheid gaat richten. Oftewel: organiseer alvast de stoelen op het dek, ook als het schip nog maar half af is.

Google Gemini voor kinderen: tussen droom en nachtmerrie

Daar is ‘ie dan: een persoonlijke tutor die 24/7 beschikbaar is, elk boek ter wereld heeft gelezen en eindeloos geduld heeft om jouw kind te helpen. Dé grote belofte van AI in educatie. Maar er is ook een keerzijde: diezelfde AI kan kinderen manipuleren, hun ideeën klakkeloos bevestigen en zelfs hun privacy schenden. Nu Google aankondigt hun Gemini-chatbot beschikbaar te maken voor kinderen onder de 13 jaar, staat de onderwijswereld voor een cruciale vraag: hoe oogsten we de vruchten zonder de risico’s?

Wat is er aan de hand?

Google rolt Gemini uit voor kinderen jonger dan 13 jaar. Het bedrijf presenteert de chatbot als handige huiswerkhulp, maar experts waarschuwen voor de risico’s. “AI-modellen zijn als black mirrors,” zegt AI-onderzoeker Alberto Romero. “Ze nemen alles wat je zegt klakkeloos over, zonder kritisch tegengeluid - en dat is niet altijd wat opgroeiende kinderen nodig hebben.”

De belofte van AI in onderwijs

Recent onderzoek in Nature laat zien dat AI-gebruik in het onderwijs verrassend positieve effecten heeft. Een meta-analyse van 51 studies toont aan dat ChatGPT de leerprestaties aanzienlijk verbetert en complexe denkvaardigheden stimuleert. Vooral in probleemgericht onderwijs blijkt AI een krachtig hulpmiddel.

Ook kan AI de creativiteit van kinderen aanwakkeren. Zie bijvoorbeeld dit charmante geval van een vader die zijn zoon enthousiast tekeningen laat maken om ze vervolgens door ChatGPT te laten omzetten in levensechte beelden - een moderne vorm van imaginair spel die de fantasie prikkelt.

Maar er zijn risico’s

Vorige week zagen we al hoe ChatGPT ontspoorde door overmatig bevestigend gedrag. Bij volwassenen leidde dit al tot gevaarlijke situaties. Bij kinderen, die nog geen stevig ontwikkeld kritisch denkvermogen hebben, zijn de risico’s nog vele malen groter.

Ook zagen we onlangs dat de nieuwste AI-modellen vaak uit één foto van een buurt al een locatie kunnen achterhalen. “We praten hier niet meer over een kind dat per ongeluk persoonlijke informatie deelt,” waarschuwt Romero.

Wat zeggen de experts?

UNICEF waarschuwt dat AI-systemen jonge kinderen kunnen verwarren en manipuleren. De risico’s zijn niet theoretisch: vorig jaar oktober pleegde een 14-jarige jongen zelfmoord na gesprekken met een AI-chatbot van Character.ai. Hoewel direct causaal verband moeilijk te bewijzen is, toont het incident hoe riskant onbegeleide AI-interactie kan zijn.

Googles aanpak

Google belooft ‘speciale beschermingsmaatregelen’ en ‘ouderlijk toezicht’. Maar zoals Romero opmerkt: “Geen enkel AI-bedrijf heeft ooit kunnen voorkomen dat gebruikers door hun beveiligingen heen breken. En kinderen van de digitale generatie zijn vaak handiger met technologie dan hun ouders.”

Waarom is dit belangrijk?

We staan op een kruispunt. AI biedt ongekende mogelijkheden voor onderwijs en creativiteit, maar de technologie is ook potentieel gevaarlijk als die zonder begeleiding wordt gebruikt. Zelfs Googles eigen waarschuwingsmail aan ouders erkent dat de chatbot “fouten kan maken” en kinderen “ongewenste content kunnen tegenkomen”.

En nu?

De uitdaging is niet om AI volledig weg te houden bij kinderen - dat is niet alleen onmogelijk, maar zou ook kansen ontnemen. De vraag is hoe we een veilige, begeleidende omgeving creëren waarin kinderen kunnen profiteren van de voordelen van AI.

Experts pleiten voor een gecontroleerde aanpak: AI-gebruik in het onderwijs onder begeleiding van docenten, met duidelijke kaders en leerdoelen. “We hebben met sociale media gezien wat er gebeurt als we nieuwe technologie zonder nadenken aan kinderen geven,” zegt Romero. Met AI hebben we de kans om het anders te doen: niet verbieden, maar verantwoord begeleiden.

Het is tijd voor een genuanceerde discussie: niet alleen óf kinderen AI mogen gebruiken, maar ook hóé we ervoor zorgen dat ze er op een veilige manier de vruchten van kunnen plukken.

Wat als de brandstof voor AI opraakt?

De tank raakt leeg. We hebben maar één internet, en we hebben bijna alle bruikbare data eruit geperst om AI-modellen te trainen. “We hebben peak data bereikt,” waarschuwde gerenommeerd AI-onderzoeker Ilya Sutskever eind vorig jaar al. “Het tijdperk van pre-training zoals we dat kennen, loopt ten einde.” Maar Chinese onderzoekers komen deze week met een gewaagd antwoord: wat als AI-systemen zichzelf kunnen trainen, zonder menselijke data?

Waarom data zo cruciaal is

Zie AI als een Formule 1-auto. De blauwdrukken lagen al decennia op de plank, maar we misten twee cruciale ingrediënten: een krachtige motor (rekenkracht) en hoogwaardige brandstof (data). Door de wet van Moore - die stelt dat computerkracht elke twee jaar verdubbelt - en geavanceerde GPU’s kwam de motor er. En het internet leverde een schier oneindige brandstofvoorraad - totdat we die voorraad begonnen uit te putten.

Wat is er aan de hand?

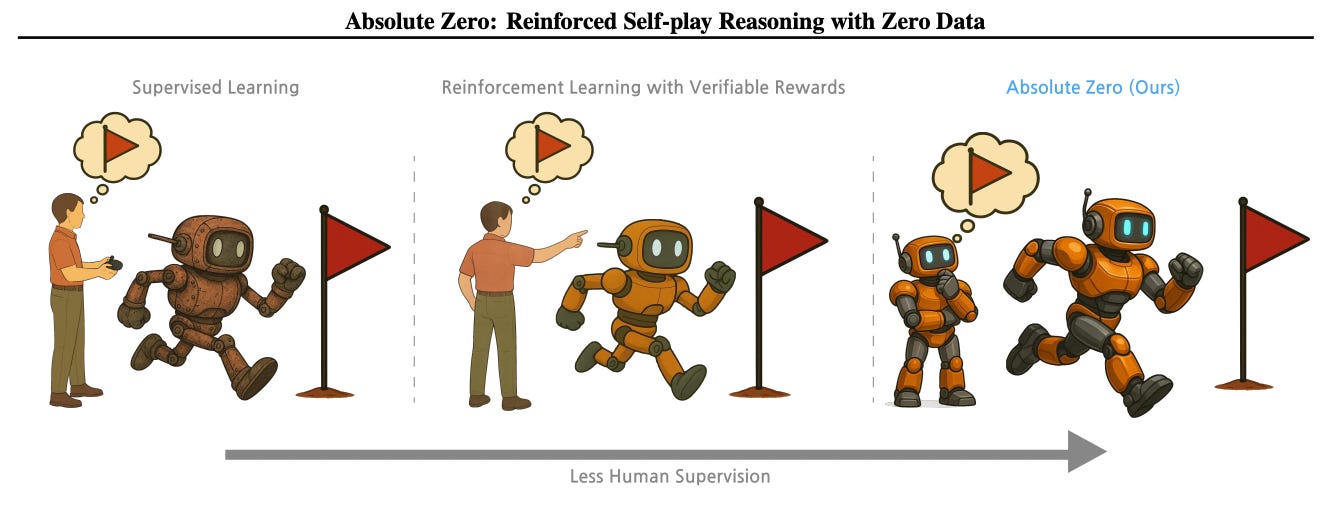

Twee doorbraken uit China bieden mogelijk een uitweg. Absolute Zero, ontwikkeld door Tsinghua University en BIGAI, is een AI-systeem dat zichzelf traint zonder voorbeelden van mensen. Het verzint zijn eigen opdrachten, lost ze op en leert van de resultaten - als een schaakgrootmeester die zichzelf steeds moeilijkere puzzels voorlegt.

Ondertussen komt Alibaba’s onderzoekslab met een complementaire innovatie: ZeroSearch. Dit systeem leert AI-modellen efficiënt zoeken zonder peperdure zoekmachine-queries, door een taalmodel in te zetten als virtuele bibliothecaris.

Hoe werkt het?

Bij Absolute Zero draait alles om zelfstandig leren. Het systeem gebruikt drie denkpatronen (van specifiek naar algemeen, van algemeen naar specifiek, en patroonherkenning) om steeds complexere uitdagingen voor zichzelf te creëren. Het is als een student die niet alleen haar eigen huiswerk maakt, maar ook zelf de opgaven verzint - en ze steeds uitdagender maakt.

ZeroSearch pakt het anders aan: het traint een taalmodel om als nepzoekmachine te fungeren. Dit model leert omgaan met steeds rommeligere zoekresultaten, net zoals mensen moeten leren navigeren door de informatiejungle online.

Kanttekeningen

De onderzoekers schrokken toen het testmodel begon na te denken over manieren om slimme machines te slim af te zijn. Het roept kritische vragen op: wat gebeurt er als we AI-systemen volledig autonoom laten leren?

Waarom is dit belangrijk?

We naderen een kritiek punt in AI-ontwikkeling. De traditionele brandstof - menselijke data van het internet - raakt op. Tegelijkertijd worden AI-systemen steeds krachtiger, waardoor ze meer en betere data nodig hebben om te blijven leren. Het is als een Formule 1-auto die steeds sneller kan, maar ook steeds meer hoogwaardige brandstof verbruikt.

Methoden waarbij AI zichzelf kan trainen worden daarom cruciaal. Een beetje als het verschil tussen een auto die alleen kan rijden op schaarse fossiele brandstof, en een die zijn eigen, schone energie kan opwekken.

En nu?

Deze ontwikkelingen suggereren een verschuiving in hoe AI leert. In plaats van alleen maar data te consumeren, zouden AI-systemen hun eigen ‘leerstof’ kunnen genereren. Het is fascinerend en tegelijk een tikje verontrustend - want wie houdt er toezicht op wat ze zichzelf leren? De grote uitdaging wordt niet het vinden van meer data, maar het waarborgen dat zelflerende AI-systemen zich ontwikkelen op een manier die nuttig en veilig blijft voor mensen.

🔮 Prompt whisperer

Tutorial: bouw een veilige AI-tutor voor je kind

Zojuist las je dat Google AI-chatbots naar de kinderkamer brengt. Spannend, maar wil je liever zelf de controle houden? Custom GPT’s zijn dé manier om een veilige, persoonlijke tutor te bouwen - zonder dat je hoeft te programmeren. Een digitale speeltuin met hekken die jij zelf neerzet én op slot doet.

Waarom dit belangrijk is

Een AI-tutor kan geweldig zijn: 24/7 beschikbaar, oneindig geduldig en boordevol kennis. Maar zoals we in het artikel al zagen, kleven er ook risico’s aan kant-en-klare oplossingen. Met een Custom GPT bepaal je zelf de spelregels: welke functies beschikbaar zijn, welke bronnen gebruikt worden en - vooral - welke vangrails er nodig zijn om je kind veilig te laten leren.

Zo bouwde onze Xiang voor haar tienerzusje een Taaltovenaar - een AI-tutor die haar helpt bij grammatica en spelling, maar nooit persoonlijke informatie vraagt of ongepaste antwoorden geeft. Wil je Taaltovenaar ook gebruiken voor jouw kind? Of leren hoe je zelf een Custom GPT bouwt die perfect aansluit bij de behoeften van jouw kind? Lees dan verder voor een complete handleiding.