Claude: verbannen door Trump, nummer 1 in de App Store

PLUS: hoe een verbod de beste reclame werd, en bouw een AI-strateeg die je scherp houdt

De AI-wereld ontwikkelt zich razendsnel, en AI Report houdt je op de hoogte. Twee keer per week de nieuwste ontwikkelingen, tools en inzichten via onze nieuwsbrief en podcast.

🗞️ Het belangrijkste nieuws

Trump weert Claude en maakt het daarmee onbedoeld de populairste app in Amerika

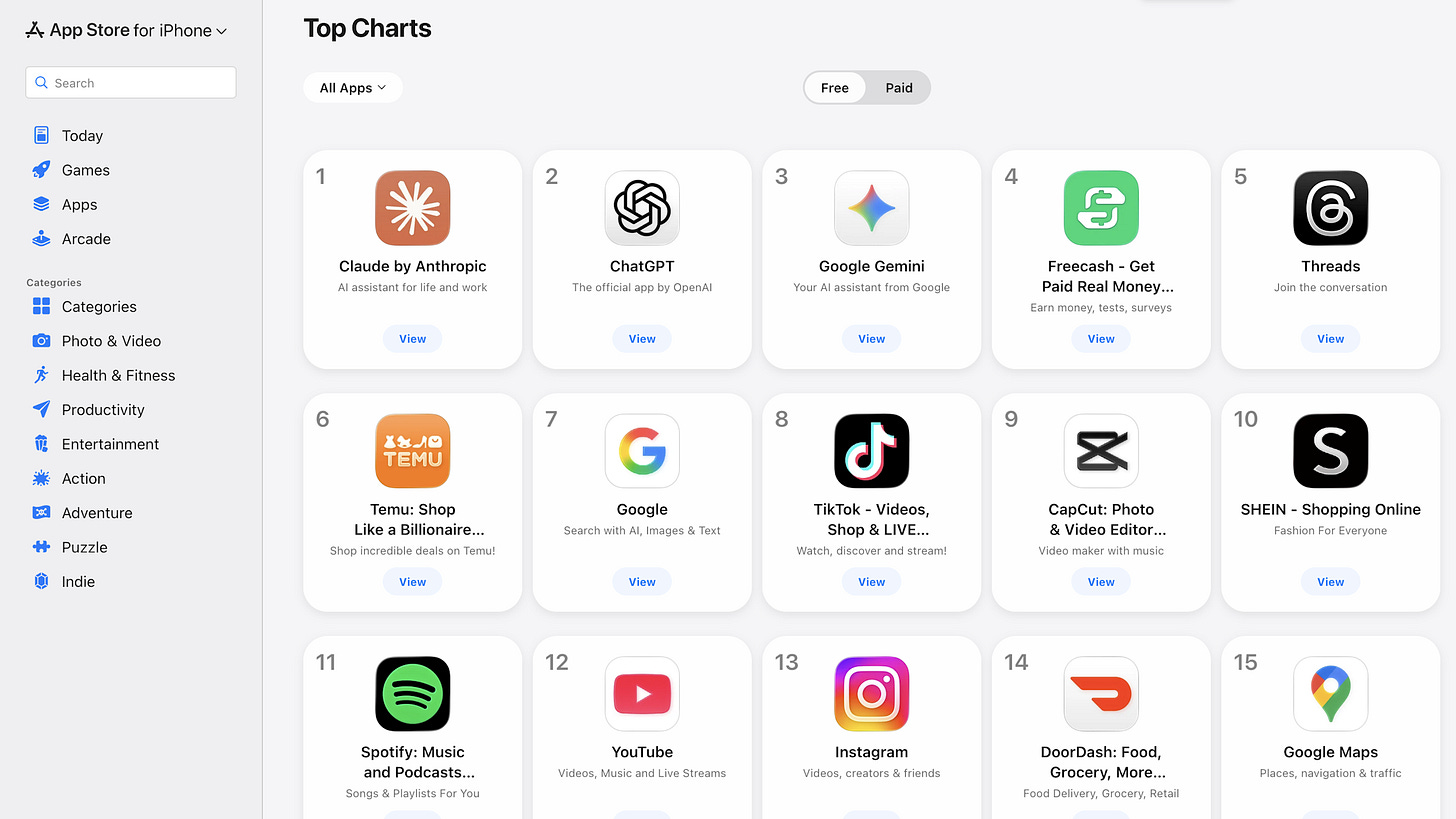

Gebruik jij Claude voor je werk? Dan is het goed om te weten dat de app die je misschien dagelijks gebruikt voor e-mails, presentaties of onderzoek sinds vrijdag officieel op de zwarte lijst is gezet door de Amerikaanse overheid. De reden? Anthropic, de maker van Claude, weigert twee grenzen te laten varen. Het gevolg? Claude is nu de nummer 1 app in de Amerikaanse App Store.

Wat is er aan de hand?

Het conflict tussen Anthropic en het Pentagon is deze week geëscaleerd tot een regelrechte breuk. Vorige week schreven we over het ultimatum dat minister van Defensie Pete Hegseth had gesteld. Die deadline is verstreken – en Anthropic heeft niet gebogen.

Anthropic-topman Dario Amodei liet in een publieke verklaring weten dat zijn bedrijf “liever niet meer met het Pentagon samenwerkt dan in te stemmen met gebruik dat democratische waarden ondermijnt.” De twee grenzen: geen massasurveillance van Amerikaanse burgers, en geen volautomatische wapensystemen, dus wapens die zonder menselijke tussenkomst kunnen doden.

De reactie uit Washington

Het Pentagon reageerde hard. Hegseth bestempelde Anthropic als ‘risico voor de toeleveringsketen’, een stempel dat normaal is voorbehouden aan vijandige landen. President Trump ging nog een stap verder en gebood alle federale overheidsdiensten per direct te stoppen met Anthropic-producten.

“De linkse gekken bij Anthropic hebben een RAMPZALIGE FOUT gemaakt,” schreef hij op Truth Social.

Waar liep het precies op stuk?

Volgens The Atlantic waren de onderhandelingen vrijdagochtend nog op koers. Het Pentagon zou een belangrijke concessie doen door vage ontsnappingsclausules te schrappen uit het contract.

Maar die vrijdagmiddag bleek dat het leger nog steeds de intentie had om met Claude bulkdata van Amerikaanse burgers te analyseren. Denk aan zoekopdrachten, gps-locaties en creditcardtransacties, allemaal aan elkaar gekoppeld. Voor Anthropic was dat een brug te ver. De deal klapte.

De discussie over autonome wapens was nog complexer. Het Pentagon stelde voor om Claude ‘in de cloud’ te houden en buiten de wapens zelf. Maar Anthropic verwierp dat argument: in moderne militaire systemen is het verschil tussen de cloud en het wapen niet zo duidelijk meer aan te wijzen. Een AI-model dat vanuit een datacenter in Virginia beslissingen neemt op het slagveld is vanuit ethisch oogpunt geen wezenlijk verschil, redeneerde het bedrijf.

OpenAI springt in het gat

Vierenhalf uur nadat het Pentagon de banden met Anthropic verbrak, tekende OpenAI (de maker van ChatGPT) een deal met het Amerikaanse leger. OpenAI-topman Sam Altman beweert dat zijn contract dezelfde rode lijnen bevat rondom surveillance en autonome wapens.

Maar er is een opvallend verschil: het contract verbiedt niet expliciet het verzamelen van publiek beschikbare data van Amerikanen. Precies het punt waarop de deal met Anthropic strandde.

Altman gaf tijdens een vraag-en-antwoordsessie op X toe dat de deal “duidelijk overhaast” was en dat “die er niet goed uitziet.” Op de vraag of hij zich zorgen maakt over toekomstige conflicten met het Pentagon, antwoordde hij: “Ja. Als we dat gevecht moeten aangaan, zullen we dat doen, maar het stelt ons bloot aan risico’s.”

De publieke reactie

De reactie van consumenten was ongekend. Claude klom van buiten de top 100 in januari naar de nummer 1-positie in de Amerikaanse App Store. Anthropic meldt dat het aantal dagelijkse aanmeldingen deze week een record brak, gratis gebruikers met meer dan 60 procent zijn toegenomen sinds januari, en het aantal betalende abonnees dit jaar is verdubbeld.

Op Reddit staat een post met 27.000 likes die stap voor stap uitlegt hoe je je ChatGPT-abonnement opzegt en overstapt naar Claude. “Dit was een berekende zakelijke beslissing om overheidsgeld na te jagen ten koste van alles wat ze beloofden,” schrijft de auteur over OpenAI. In de comments op sociale media, van X tot Reddit tot LinkedIn, kondigen mensen massaal aan dat ze hun ChatGPT-abonnement opzeggen en overstappen naar Claude.

Intussen tekenden honderden werknemers van zowel Google als OpenAI een open brief waarin ze oproepen om dezelfde grenzen te trekken als Anthropic.

Het bedrijf dat altijd al anders was

Anthropic werd in 2021 opgericht door voormalige medewerkers van OpenAI, onder wie broer en zus Dario en Daniela Amodei. Dario was vicepresident onderzoek bij OpenAI, maar vertrok omdat hij vond dat het bedrijf te weinig aandacht besteedde aan veiligheid. Anthropic presenteerde zich vanaf dag één als het ‘AI-veiligheidslaboratorium’: een bedrijf dat krachtige AI bouwt, maar met enige voorzichtigheid.

Die filosofie vertaalde zich in concrete keuzes. Anthropic publiceerde een gedetailleerd veiligheidsprotocol, investeerde in onderzoek naar hoe AI-modellen intern werken, en stelde als eerste grote AI-bedrijf een onderzoeker aan voor ‘AI-welzijn’.

Het bedrijf gaf Claude een zogenaamd ‘zieldocument’ van 14.000 woorden aan instructies over persoonlijkheid, ethiek en gedrag, en behandelt zijn AI-modellen nadrukkelijk als een soort entiteiten. Toen het vorige model met ‘pensioen’ ging, kreeg het een eigen blog om “zijn overpeinzingen te delen met de wereld”.

Het Pentagon wil daar niets van weten. Dat wil een hulpmiddel dat doet wat het leger vraagt, zonder beperkingen.

Maar het verhaal is minder zwart-wit dan het lijkt

Het is verleidelijk om Anthropic neer te zetten als de principiële held tegenover een opdringerig leger. De werkelijkheid is ingewikkelder.

Anthropic is niet tégen militair gebruik van Claude, integendeel. Het bedrijf was het eerste AI-lab dat zijn model beschikbaar stelde op de besloten netwerken van de Amerikaanse overheid. Amodei schrijft in zijn verklaring dat hij “waarlijk gelooft in het existentiële belang van AI om de Verenigde Staten en andere democratieën te verdedigen.”

Claude werd ingezet bij de operatie om de Venezolaanse oud-president Maduro op te pakken, en volgens Axios en The Wall Street Journal werd het deze week nog gebruikt bij de Amerikaanse aanval op Iran. Anthropic ondersteunt het leger actief voor taken als inlichtingenanalyse, operationele planning en cyberoperaties. De twee grenzen die het bedrijf trekt, voor massasurveillance en autonome wapens, zijn beperkt in omvang, maar bleken voor het Pentagon onacceptabel.

De eigen grenzen verschuiven ook

Bovendien worstelt Anthropic zelf zichtbaar met de druk. In een recent interview met podcaster Dwarkesh Patel was Amodei opvallend openhartig: “We staan onder ongelooflijke commerciële druk, en maken het onszelf nog moeilijker omdat we al dat veiligheidswerk doen. De druk om economisch te overleven én onze waarden te behouden is gewoon ongelooflijk.”

Die druk vertaalt zich in concrete concessies. Eerder deze maand onthulde Time Magazine dat Anthropic de kernbelofte van zijn veiligheidsprotocol heeft geschrapt: de toezegging om nooit een AI-model te trainen zonder vooraf te kunnen garanderen dat de veiligheidsmaatregelen toereikend zijn. Het was jarenlang hét visitekaartje van het bedrijf en het bewijs dat ze het anders deden dan de rest.

Wetenschappelijk directeur Jared Kaplan legde uit waarom ze die belofte lieten varen: “We voelden dat het niemand zou helpen als wij zouden stoppen met het trainen van AI-modellen terwijl onze concurrenten volle kracht vooruit gaan.” Chris Painter van METR, een onafhankelijke organisatie die AI-modellen beoordeelt op risicovol gedrag, noemt de koerswijziging een teken dat “de methoden om risico’s te beoordelen en te beperken de snelheid van de technologische ontwikkeling niet bijhouden.”

Kortom: Anthropic trekt een principiële grens tegenover het Pentagon, maar verschuift tegelijkertijd zijn eigen grenzen onder commerciële druk. Het laat zien hoe complex de positie is van een bedrijf dat probeert om zowel het snelst groeiende AI-lab ter wereld te zijn (de omzet groeit al drie jaar op rij met een factor tien) als het meest verantwoorde.

Wat betekent dit voor jou?

Als Claude-gebruiker verandert er voorlopig niets. Anthropic benadrukt dat alle commerciële diensten, de app, de website, de zakelijke abonnementen, gewoon beschikbaar blijven. De breuk beperkt zich tot militaire contracten van de Amerikaanse overheid.

Maar het conflict raakt aan een grotere vraag die ons allemaal aangaat: wie bepaalt wat AI wel en niet mag doen? Het Pentagon vindt dat alleen de wet die grenzen mag stellen. Anthropic vindt dat sommige toepassingen nu nog niet verantwoord zijn, ongeacht wat de wet toestaat.

Klimaatonderzoeker en techdenker Ramez Naam vat het nuchter samen: “Geen enkel AI-bedrijf kan voorkomen dat het leger AI misbruikt – het is simpelweg te makkelijk om een ander model te pakken. Maar door de kwestie publiek te maken, heeft Amodei de aandacht van kiezers, de pers en het Congres gevestigd op mogelijk misbruik van AI. Dát is de winst.”

Block schrapt 4000 banen ‘vanwege AI’: bezuiniging of AI-washing?

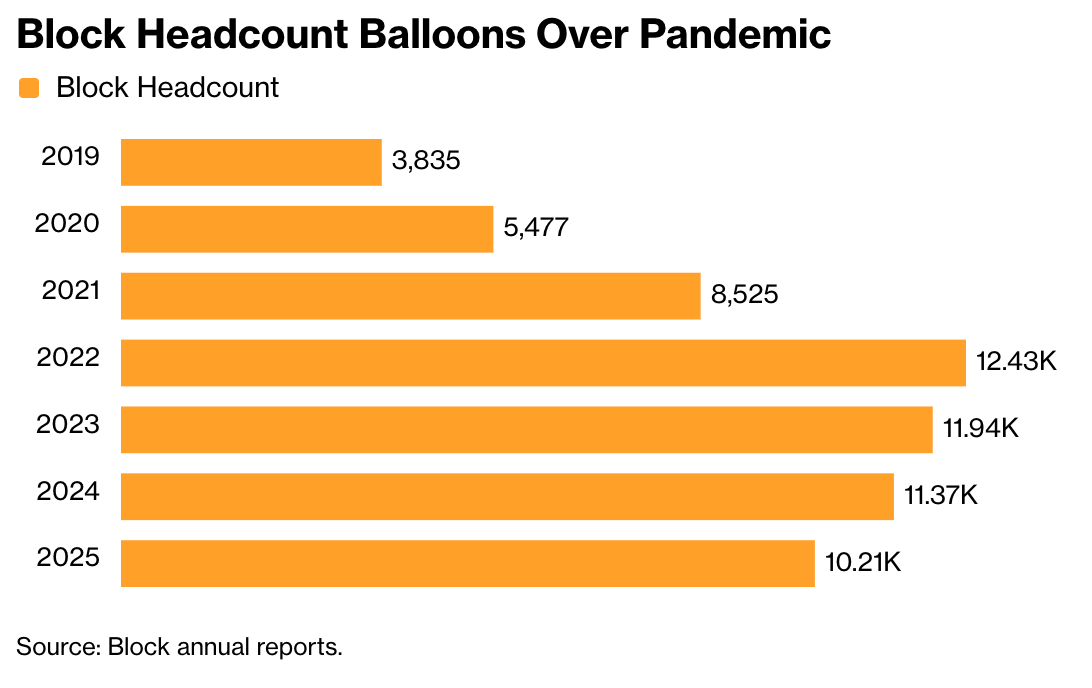

Jack Dorsey, medeoprichter van Twitter en betaalbedrijf Block, ontsloeg deze week bijna de helft van zijn personeel. Zijn verklaring: AI maakt het mogelijk om met minder mensen meer te doen.

“Ik had twee opties: geleidelijk bezuinigen over een periode van maanden of jaren, of eerlijk zijn over onze huidige situatie en direct handelen,” schreef hij aan zijn werknemers. “Ik koos het laatste.”

Maar klopt dat verhaal?

Het fenomeen heeft inmiddels een naam: AI-washing. Bedrijven die gewone bezuinigingen verpakken als technologische vooruitgang. En bij Block zijn er genoeg redenen om vraagtekens te zetten.

Het bedrijf verdrievoudigde zijn personeelsbestand tijdens de pandemie, van 3800 naar ruim 12.000 medewerkers, en was trager dan concurrenten met afschalen. Het aandeel was sinds begin 2025 met zo’n 40 procent gedaald, een koers die niets met AI te maken had en alles met een bedrijf dat uit zijn voegen groeide. “Dit gaat meer over een te ver uitgedijde organisatie dan over AI,” zegt analist Zachary Gunn van Financial Technology Partners.

Maar laten we de timing van dit alles niet vergeten. De aankondiging kwam een paar dagen nadat een virale post op Substack van onderzoeksbureau Citrini Research een doemscenario schetste van massawerkloosheid door AI, wat de beurzen deed schudden. De angst zit er goed in, en bedrijven die AI als reden opvoeren voor het ontslaan van personeel worden door beleggers beloond.

De cijfers zeggen iets anders dan de koppen

Aan de andere kant van het verhaal: Goldman Sachs publiceerde vrijdag een analyse die stelt dat de angst voor een AI-ontslaggolf “buitensporig” is. De bank schat dat AI-gerelateerde sectoren op dit moment slechts 5000 tot 10.000 banen per maand kosten in de VS. Ook Christine Lagarde, voorzitter van de Europese Centrale Bank, zei deze week dat economen “nog niet” de gevreesde ontslaggolven door AI waarnemen.

Wall Street trok zich weinig aan van de nuance. Het aandeel van Block steeg vrijdag met 15 procent na de aankondiging

📅 Masterclass deze donderdag 5 maart: zo laat je anderen inloggen op je app

Je hebt een app gebouwd – maar hoe laat je anderen erop inloggen? En hoe onthoud je wat ze invullen? In de vierde masterclass laat Wietse zien hoe je van ‘alleen ik kan dit gebruiken’ naar ‘iedereen kan meedoen’ gaat: authenticatie, databases en alles wat je nodig hebt voor een echte multi-user app.

Deel 1, 2 en 3 gemist? De vorige masterclasses – van je eerste app bouwen tot distributie – kun je hier, hier en hier terugkijken.

De risico’s van quantumcomputers, onderschat ze niet!

Quantumcomputing vormt inmiddels een serieuze uitdaging voor onze huidige cryptografische systemen. De overstap naar post‑quantumcryptografie (PQC) is daarom essentieel. Lees welke stappen daarvoor nodig zijn.

🔮 Prompt whisperer

Bouw je eigen strategisch adviesteam met AI (deel 3 van 3)

Vandaag: een strategisch adviseur die je helpt kiezen én prioriteren

De afgelopen weken bouwden we je klantexpert en marktanalist. Je weet nu wie je klant is en wat er in je markt speelt. Maar kennis alleen is niet genoeg. De echte vraag is: wat ga je ermee doen?

Dat is waar de meeste mensen vastlopen. Niet door gebrek aan informatie, maar door een overvloed eraan. Te veel kansen, te veel bedreigingen, te veel mogelijke richtingen. En dus gebeurt er vaak... niets. Of alles tegelijk, wat op hetzelfde neerkomt.

Vandaag bouwen we het sluitstuk van je adviesteam: een strategisch adviseur die je helpt om alle inzichten te vertalen naar concrete keuzes. Iemand die niet alleen meedenkt, maar je ook dwingt om te kiezen, en je eerlijk zegt wanneer je plannen niet kloppen.

Wat leer je vandaag?

Hoe je een AI-strateeg opzet die je helpt scherpe keuzes te maken.

Een kant-en-klare systeemprompt die je direct kunt overnemen.

Hoe je een SWOT-analyse maakt die verder gaat dan vier vakjes invullen.

Je prioriteiten bepalen: wat moet nú en wat kan wachten?

Scenario’s doordenken: wat als het tegenzit? Wat als het meezit?

Pro-tips om je strategisch adviseur optimaal te benutten.